Announcement

Things are always unexpected!

Recent Posts

Tags

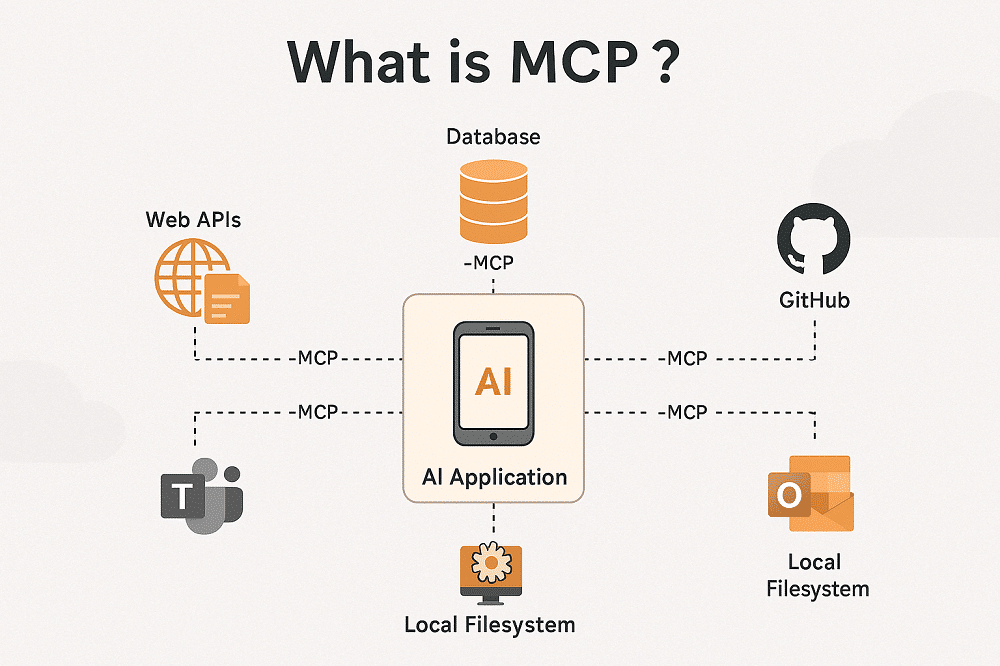

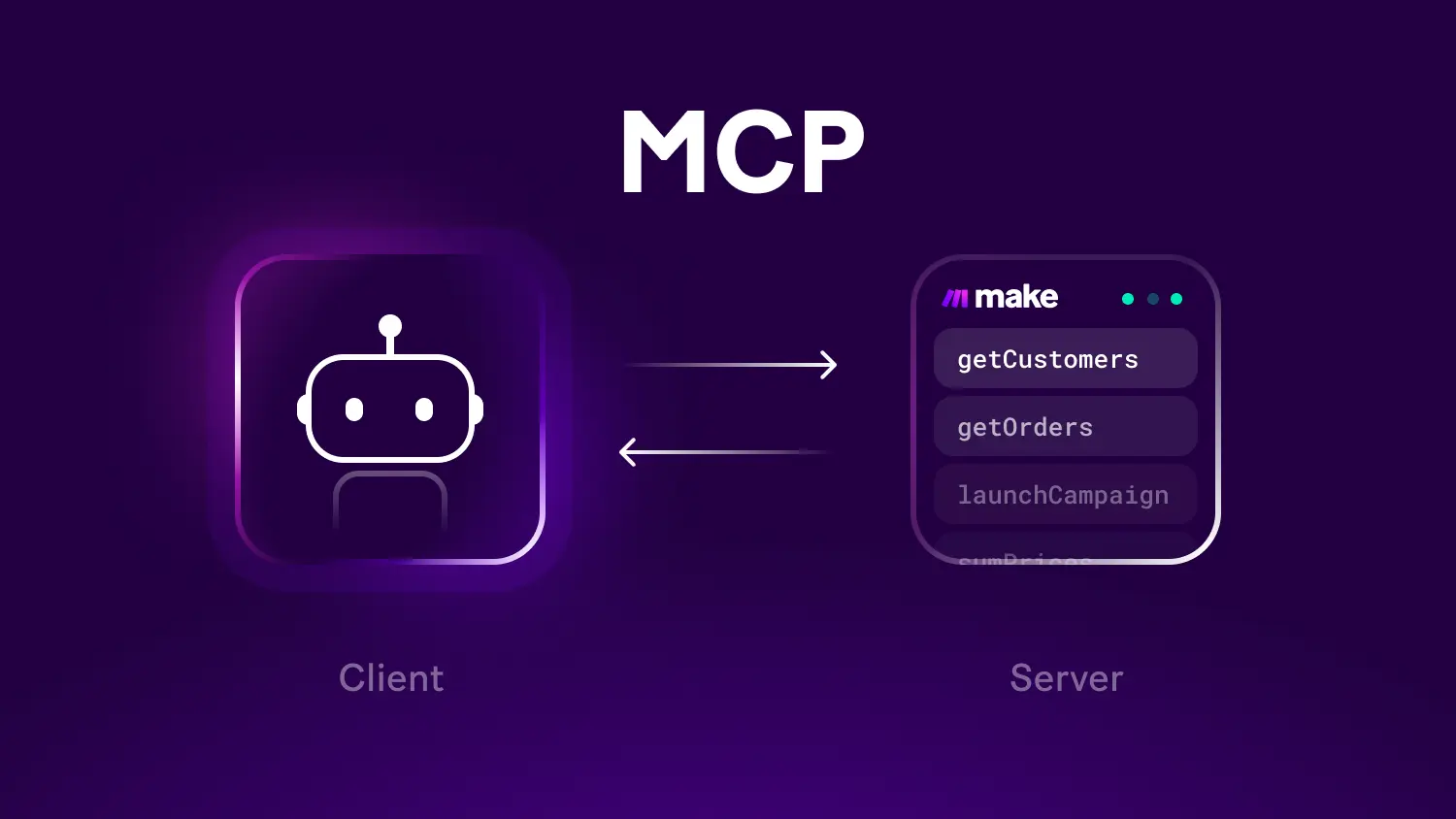

MCPA2AAIAI Native DevBig DataBeamSparkFlinkMapReduceRDDCloud ComputingPaaSIaaSCloud NativeKubernetesDevOpsContainerDockerInfrastructureArchitectureIaCTerraformCrossplanePulumiArgo CDVPCCloud Native FoundationGo CoreGoHelmruncKustomizeOCIBuildKitcraneOCI ImageOCI RuntimeLinux NamespaceLinux CGroupK8S Manifest

Website Info

Article Count :

647

Total Word Count :

1317.1k

Last Update :